背景

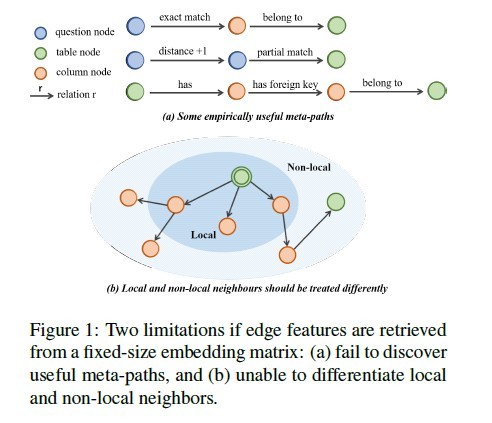

虽然RATSQL等融合了关系信息,但目前仍有两点限制,一是无法发现有效的源路径(RATSQL是预先定义好的关系),二是相邻两个点,无法区分是不是local,即同一个表内。

模型

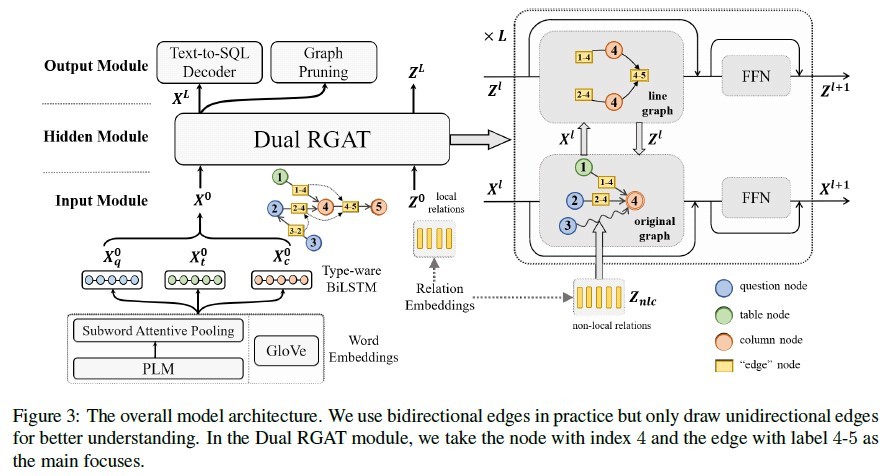

编码器用的是双塔的关系图注意力网络(即不直接cross交互的分别编码的结构,推理速度更快),去编码scheme的表信息、字段信息以及问题信息。然后同样使用和RATSQL一样的解码器AST抽象语法树。两个方法的区别在于编码器,前者是相对位置编码的自注意力层,后者是图注意力层,均融合了关系信息,才利用了Glove嵌入,和PLM的迁移学习能力。从实验结果上看后者表示能力更强。

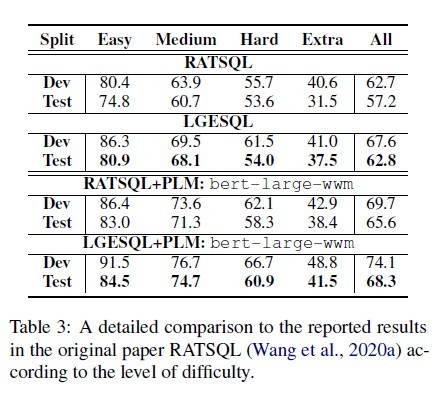

结果